Sıfırdan LLM Geliştiren Yerli Projeler İçin ETVZ Entegrasyon Rehberi

Milli Zekâyı Vicdanla Tahkim Etmek: Epistemik Denetim, Açıklanabilir Güvenlik ve Dijital Egemenlik Mimarisi 0. Kavramsal Çerçeve ve Makalenin Tezi Bu metin, sıfırdan Büyük Dil Modeli (LLM) geliştiren yerli projeler için Etik Temelli Vicdani Zeka (ETVZ) entegrasyonunu, yalnızca “güvenlik filtresi” ya da “uyumluluk modülü” gibi dar bir perspektifte değil; epistemik denetim, açıklanabilir güvenlik, kurumsal hesap verebilirlik […]

Etik Temelli Vicdani Zeka (ETVZ) Sisteminde Açıklanabilir Güvenlik ve Epistemik Denetçilik: Büyük Dil Modellerine Yönelik Hesaplamalı Vicdan Mimarisi

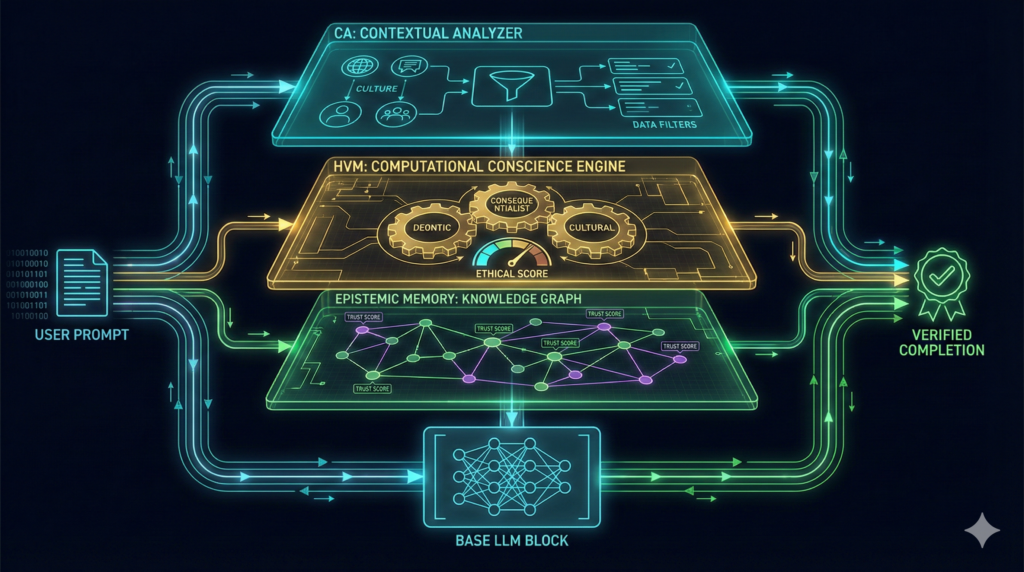

Özet Bu çalışma, Büyük Dil Modellerinin (LLM) ürettiği çıktılarda güvenlik, doğruluk ve hesap verebilirlik sorunlarını ele alan Etik Temelli Vicdani Zeka (ETVZ) çerçevesinin kapsamlı akademik temelini ortaya koymaktadır. ETVZ, Epistemik Temelli Veri Zinciri üzerine konumlanan, kararlarını yalnızca kural tabanlı filtrelerle değil; ontolojik ilişkiler, epistemik kanıtlar ve geri izlenebilir veri yolları üzerinden gerekçelendiren bütüncül bir mimarı […]

Yapay Zekâda “Basiretli” Yanıt Mekanizması: Epistemik Hafıza ve Neo4j ile Doğruluk Denetimi

Özet Büyük Dil Modelleri (LLM), doğası gereği istatistiksel olasılıklara dayanır; bu yapı onları dil üretiminde çok güçlü kılarken, “doğruluk” konusunda kırılgan hale getirir. Model, bildiği ile bilmediği arasındaki sınırı her zaman ayırt edemez; bu durum “halüsinasyon” (uydurma bilgi) ve bilgi kirliliği gibi sistemik sorunlara yol açar (Huang et al., 2023; Ji et al., 2023). ETVZ […]

Büyük Dil Modelleri İçin Yerli ve Milli Bir Üst Katman: ETVZ Teknik Entegrasyon ve Adaptasyon Protokolü

Özet Amaç: Ulusal yapay zeka stratejileri kapsamında geliştirilen Büyük Dil Modelleri (LLM), yüksek işlem kapasitelerine sahip olmalarına rağmen, kültürel uyumlandırma ve etik denetim süreçlerinde ek katmanlara ihtiyaç duymaktadır. Bu çalışma, ETVZ (Etik Temelli Vicdani Zeka) platformunun, mevcut bir ana dil modeli üzerine “açık kaynaklı etik denetim katmanı” olarak entegre edilme protokollerini teknik detaylarıyla incelemeyi amaçlamaktadır. […]

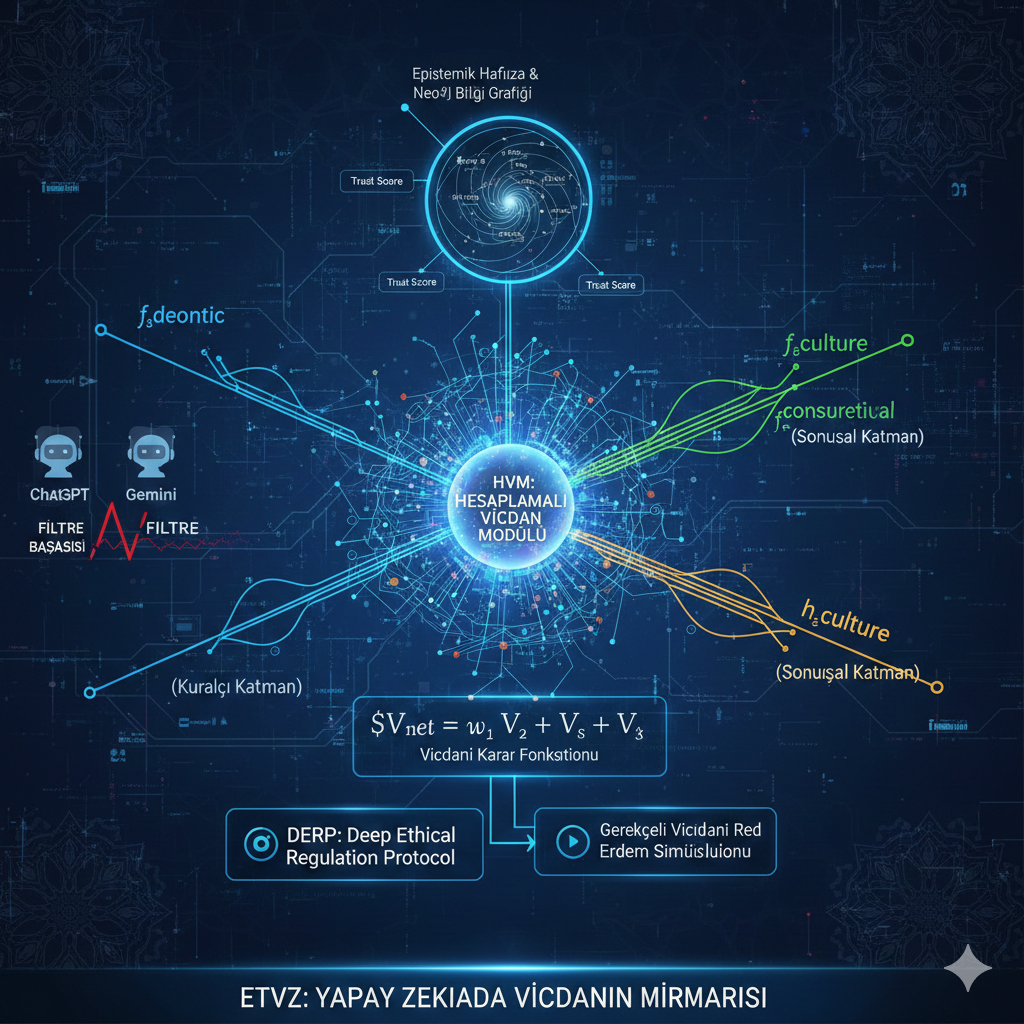

Yapay Zekâ Sistemlerinde Vicdani Muhakeme Katmanı: ETVZ Teknik Mimarisi ve Büyük Dil Modelleriyle Karşılaştırmalı Analiz

Özet Günümüz Büyük Dil Modelleri (BDM), etik uyumlandırma süreçlerinde İnsan Geri Bildirimli Pekiştirmeli Öğrenme (RLHF) ve statik güvenlik filtrelerine dayanmaktadır. Bu çalışma, etik değerlendirmeyi sistem çekirdeğine entegre eden Epistemik Temelli Vicdani Zekâ (ETVZ) mimarisini incelemekte ve ChatGPT ile Gemini gibi önde gelen modellerin etik karar alma mekanizmalarıyla karşılaştırmalı analiz sunmaktadır. ETVZ’nin grafik tabanlı epistemik hafıza […]

RLHF’in Ötesi: Büyük Dil Modellerine “Hesaplamalı Vicdan” Mimarisi Entegrasyonu (ETVZ Teknik Derlemesi)

Yazar: Göktürk KADIOĞLU Tarih: Aralık 2025 Yönetici Özeti (Abstract) Mevcut Büyük Dil Modelleri (LLM’ler), “bir sonraki token tahmini” (next-token prediction) prensibiyle çalışan güçlü stokastik motorlardır. Ancak bu modeller, ürettikleri çıktıların anlamsal doğruluğunu veya etik sonuçlarını içsel olarak “muhakeme” yeteneğine sahip değildir. Mevcut hizalama (alignment) teknikleri—örneğin RLHF (Reinforcement Learning from Human Feedback)—genellikle modelin ağırlıklarına gömülü statik […]